Tech Blog

【じゃんけんAI】AIモデルの作り方

こんにちは、小野です。

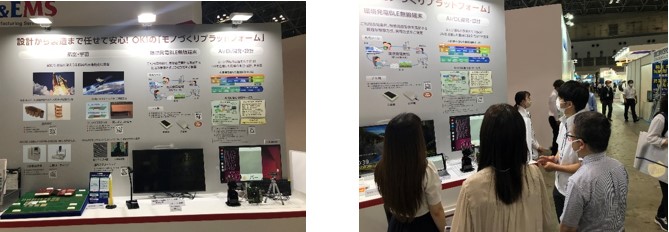

今回は6月21日~23日に東京ビッグサイトでものづくりワールドという展示会が開催されました。私たちOKIアイディエスは、その中の「ものづくりODM/EMS展」の一角にOKI-EMSグループとして展示会に出展していました。

AIを活用したサービスや製品を紹介している企業が多くなっていることが目に見えてわかりました。「AIを使ってみたい。」「AIであんな課題を解決したい。」と考えている人たちは多いんだなと思いました。最近はChatGPTのような生成系AIも普及してきており、その勢いを感じました。ですが、一番大事なのは「AIで推論した結果に対して、何をどうするか?」という点だと思います。さまざまな業界の方々にお立ち寄りいただきましたが、そういった部分についての深堀が難しくもあり、また面白いなと感じました。

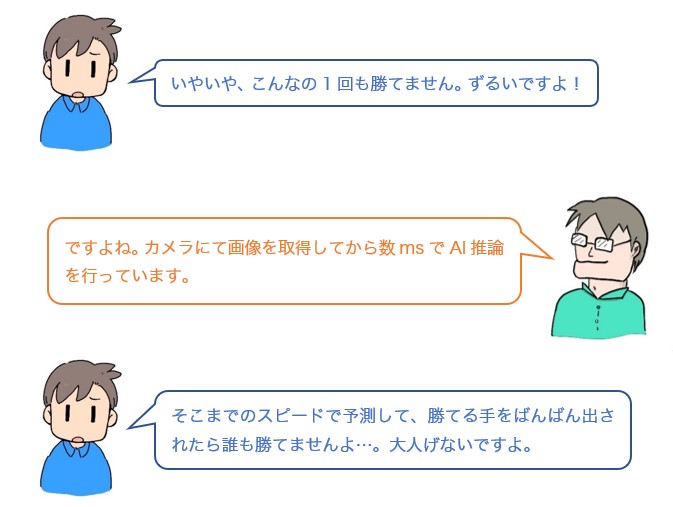

「AI推論した結果に対して、何をどうするのか?」というテーマを理解していただくべく、私たちOKIアイディエスでは「じゃんけんAI」を展示しました。カメラの前に手を出して、グー、チョキ、パーを出すと、その手に勝つ手をロボットアームが出してくる、というものです。OIDSの今までのデモは、映像や画像に対してAIで推論した結果に応じた画像などを重畳して外部のモニターへ出力するというものでした。ロボットハンドのような目に見えて動きのあるものは、遠くから見ても気になってしまいますよね。多くお客様に興味を持っていただくことができました。

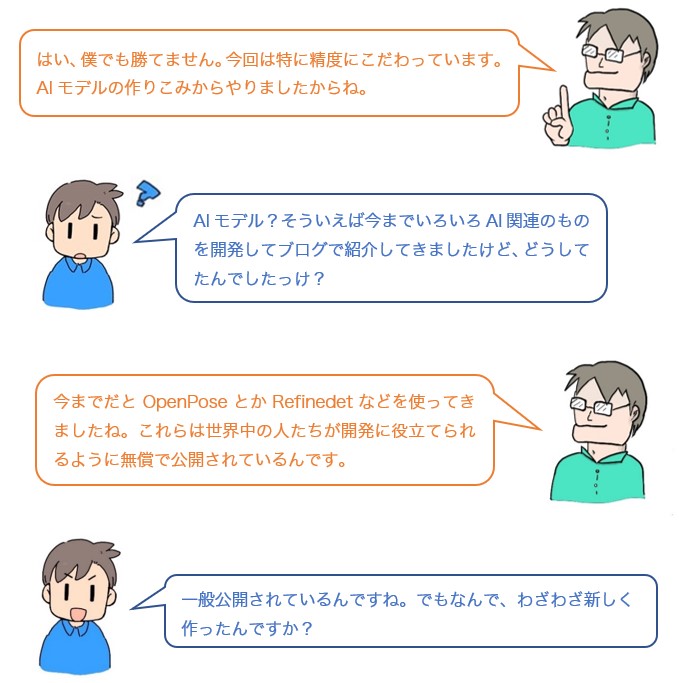

このデモ開発を通して、OKIアイディエスとしては初めてモデル開発にチャレンジをしました。従来の開発ではAIモデルとしてOpenPoseやRefinedetなどを利用してきました。AI開発の中でも上流の工程にあるモデル開発がどんなものなのか、実際の開発作業を通して体感してみたいという開発メンバーたちの思いがありました。

今回はそんな「じゃんけんAI」のAIモデルについて解説していきます。

データセットの準備

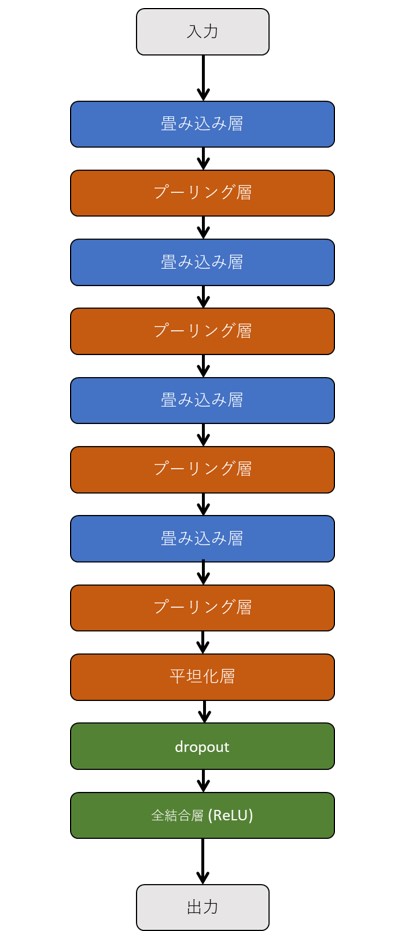

畳み込みネットワーク:CNN(Convolutional Neural Network)

最後に

- お問い合わせ

- お問い合わせフォームはこちら

- ※記載されている会社名、製品名は、各社の商標または登録商標です。

- ※ここに記載されている仕様、デザインなどは予告なしに変更する場合があります。